字體:小 中 大

字體:小 中 大 |

|

|

|

| 2024/04/16 11:03:46瀏覽589|回應0|推薦6 | |

|

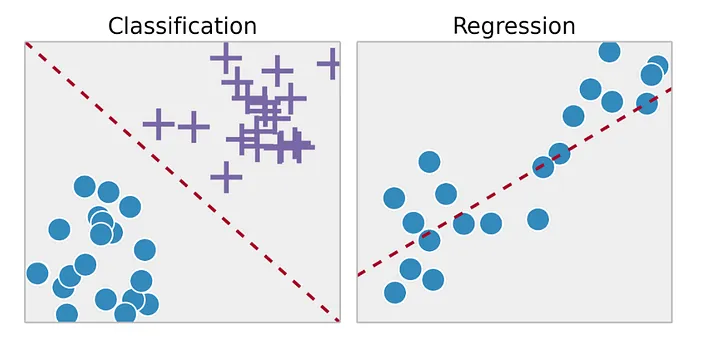

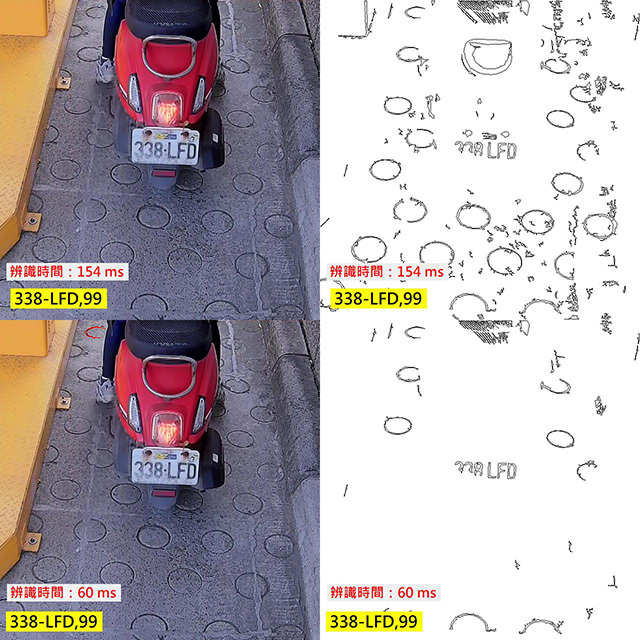

機器學習已經是大家做AI時的重要核心技術,但是多數人可能對於機器如何「學習」的概念很模糊?用白話文說就是將需要處理的資料先用很多屬性加以量化!譬如一個人會有身高、體重、性別、膚色、乃至跑步的速度等等很多可以量化的屬性,當你想要找到身體強壯適合當軍人的人時,就可以用多個屬性作較複雜的分類,找到做適合的人選。如上示意圖就是用X與Y兩個屬性將資料用一條虛線(函數)分成兩類!分類結果越符合聰明人的判斷時就是越好的「學習」成果了! 我雖然常常批評機器學習等所謂的AI技術,但我也說我一直都很認真學習這些技術,無時無刻不在思考如何引用到我的影像辨識技術中,替我的產品加值!這是真的!譬如前些時我已經把局部區域的CNN字元搜尋技巧納入我的車牌辨識演算法,解決了很多因為影像模糊或貼紙等意外雜訊產生的字元沾連問題!方法本身沒有對錯,但要看是不是用對了地方! 最近再度引進機器學習技術中上述的分類概念,大幅精簡需要處理的目標資料量!讓整體辨識時間幾乎快了一倍以上!就是嘗試將OCR程序找到的所有可能是字元的目標群,用多個參數指標(如字元高度與前景背景的對比度等等)做分類,進一步分出「可能」是車牌字元,與「不可能」是車牌字元的目標,然後只針對較可能的一群做後續分析,資料量大減速度就變很快了!

如上圖,我原本的演算過程是必須從158個OCR程序找到的目標之中作排列組合,找到正確的車牌!很像麻將牌越多,要找到正確的組合胡牌當然就耗時越久!如果可以進一步將158個目標作分類,用較簡單的方式先排除掉更多不可能的目標,那需要排列組合的次數就大幅減少,辨識速度就快了! 之前我一直糾結在以單一的目標屬性去作門檻分類,但事實是任何單一屬性的簡易分類都不夠好,也就是不夠聰明,門檻太低目標就還是很多,門檻高了又容易把正確的字元誤殺了!就像只用身高決定誰能不能當兵一樣,不夠聰明!但是機器學習的貝氏定理允許我們同時用多個屬性作組合性的指標分類,如上上圖就是用X與Y兩個維度找出分界線分類的示意圖!理論上用更多維度的空間(屬性)作更複雜的3D、4D或5D的分類都可以的! 我目前也只用了字元高度與前景背景對比度這兩個屬性作初步目標群的2D向量分類,效果就很好了!以上例來說,158個可能字元目標縮減到只剩57個!辨識時間也從150毫秒減少到60毫秒!讓我的辨識速度快了一倍!而且因為排列組合目標錯誤造成的錯誤風險也同步降低了!辨識率還會更高的! 所以不要以為我只是個逢「AI」必反的偏激份子!我比多數只會套用機器學習模式,還自稱AI專家的半調子強多了!我可以在最適當的程序中更精準有效的引用機器學習技術並組織出最「AI」的影像辨識軟體!這個演算發明只是再一次的證明:任何ML、DL與CNN都可以被我收編到我的OCR辨識程序之中!只是它們真的不夠格成為影像辨識的主體!在適當的位置當個稱職的配角就剛剛好! |

|

| ( 心情隨筆|工作職場 ) |