字體:小 中 大

字體:小 中 大 |

|

|

|

| 2023/06/06 18:17:24瀏覽23700|回應0|推薦8 | |

當ChatGPT來敲法官的門---淺談AI應用於司法審判的原則與方式 (發表於6/5/2023《當代法律》雜誌。網址點此) 王道維[1] 、邱筱涵[2] 、ChatGPT[3]

摘要 本文探討AI技術如何協助司法審判。從AI與司法的矛盾糾結出發,通過區分法官的核心業務與非核心業務,釐清法官對於AI應用於司法審判的態度,整理AI和ChatGPT的技術特點,提出「審慎積極原則」,建議應該開發並使用「可信賴的AI」於司法審判中,並預備相關措施。本文認為,AI應用於司法審判面臨挑戰,但不應該一味反對,應該深入研究AI在司法領域的最佳實踐和應用方法,從具體範例拉近想像與實際之間的距離。從公共化AI的角度出發,本文建議如何突破現有技術、政策、產業三方結構面的僵局,更有效地推動AI應用於司法審判領域,提升司法效能,同時避免侵害法官審判的獨立性。本文期待未來AI能夠充分發揮其潛力,成為法官的可靠助理,為公平公正的司法審判做出有意義的貢獻。 (by ChatGPT)

大綱 壹、AI與司法的矛盾糾結之處 貳、關於法官核心與非核心業務之區分 參、我國法官對於AI科技應用的態度 肆、ChatGPT的簡要技術說明與三大應用類型 伍、AI與ChatGPT應用於司法審判的原則與條件 陸、若干應用於司法審判之「可信賴的AI」雛型 柒、司法AI的結構性困境與公共化AI的解方 捌、未來展望:可靠的AI助理 附錄:ChatGPT參與本文寫作的方式

壹、AI與司法的矛盾糾結之處

自從2016年AlphaGo贏過人類圍棋冠軍而一戰成名後,第三波人工智慧(Artificial Intelligence, 以下簡稱AI)許多突破性的發展已經明顯影響整個科技與產業發展的方向,也直接間接地透過各種科技產品或應用軟體進入大眾的生活。但是在眾多AI相關產品中,2022年11月30日橫空出世的ChatGPT,更是將文字語言的生成式AI(Generative AI)[4]發揮到極致,以有史以來最接近通用型AI(Artificial General Intelligence, AGI[5])的身分直接衝擊高等教育與眾多產業。2023年3月15日所發表最新版本的GPT-4更是高分通過各種學科或國家考試[6],又能結合圖片與文字的多模態表達[7],展現如何將語言文字與視覺圖像作更多樣性的連結[8]。因此文書處理兩大霸主,Google[9]與Microsoft[10],也相繼宣布將這類生程式AI更多融合進入線上或線下的工具中(包括Google/Chrome的應用程式、Microsoft搜尋引擎New Bing與Office 365等系列產品),甚至號稱只要一句話就能完成簡報、影片或網頁程式[11],未來顯然將直接改變更多職業與工作型態。

雖然幾乎沒有一個領域不受到此波AI發展的影響,但是本文認為對司法領域而言,AI所帶來的挑戰又比其他領域有著更為糾結的複雜關係,已有許多在過往的研究著作中闡明[12,13]。以下本文從AI與司法之間所獨有的機會性、挑戰性、敏感性、爭議性與規範性的五個面向略作簡述:

一、機會性: 眾所周知的是,司法判決牽涉到大量的數據與文字資料,但是司法人員所能處理資料的數量顯然亦有其極限。在人力成本高漲的時代,各類AI智慧科技的運用,例如提供法律諮詢、蒐集文獻案例、分析文件證據、草擬契約書狀等,的確有可能提高司法效率與品質[14,15]。

二、挑戰性: 雖然大量且高品質的司法資料是發展AI技術重要的訓練材料,但是司法相關資料之特性在於相當複雜且具有多樣性。除了判決書以外,亦包括各類法律條文、涵釋、卷宗、圖表及公文等資料,難以簡單歸類統整,又常因時代或地域之相異而有所不同。司法工作者除法官外,尚有檢察官與律師,所以如何將司法相關資料有效統整回饋給AI技術端使用,本身可能需要更多共識,且需要有系統性的資料治理能力。

三、敏感性: 在眾多AI應用於司法領域的方式中,對於司法判決的預測往往是社會大眾最為關心與期待的發展,希望能因此減少不必要之司法資源消耗。然此往往直接涉及法官依法獨立審判或量刑之重要核心價值,因此可能引發較多爭議。近年來,這些議題也有許多學者在與司法AI有關之會議或論文中提出,國外亦有實際案例討論[16]。

四、爭議性: 由於AI之應用需要從大量的原始資料中學習相關的模式,也因此可能因為資料偏誤而產生關於倫理、隱私、偏見、人權或究責方式等法律問題[17]。司法人員作為直接處理面對社會上這類問題的公正第三方,所扮演的角色自然與一般人有所不同。如何避免因為AI之應用進入司法領域,反而讓自己的角色混淆陷入窘境,亦係一項重大挑戰。

五、規範性: 現代國家之司法制度均係在法律規範範圍內實施,其中當然包括AI發展之相關規定。然法律規範是隨著社會發展因應或調整,因此法律人更需關注AI於整體社會之真實需求與發展趨勢,適時修改規範或相關配套措施[18],始能確保AI在司法領域的合理運用[19]。司法單位作為法制規範的判斷者,也當然可以透過這些規範的詮釋來限制或鼓勵AI的應用[20,21]。

基於以上原因,AI應用於司法實務遠比應用於其他領域更為複雜。由於相關問題已經在許多文獻中探討,本文僅先集中從司法制度中最核心的關鍵角色──法官,來探討AI應用於審判的可能。此外,雖然ChatGPT只是眾多AI模型應用之一,但是其廣泛又強大的文字處理能力在強調書寫表達的法律體系中,又有其特殊的角色。因此本文所提及的AI應用雖然包含各類AI的模型,但也會在部分段落針對ChatGPT所獨有的特色或應用方式予以說明。事實上,本文認為,接近通用型AI的ChatGPT若能適當使用,未來可以作為整合其他與司法有關的AI工具的平台,協助節省法官審理案件的時間並提升審判的品質,成為法官可靠的AI助理。

貳、關於法官核心與非核心業務之區分

為界定本文所欲討論AI技術應用於法官工作之範圍,本文認為首先需要區分法官工作事項之核心與非核心業務,並進一步將非核心業務區分為與審判相關及與審判無關者。此三類業務對於AI科技的應用應有不同程度的影響。

依我國憲法第80條規定:「法官須超出黨派以外,依據法律獨立審判,不受任何干涉。」因此法官最重要的核心業務即為「審判」,其中包括審理案件、指揮訴訟、決定強制處分、撰寫裁判書等等。法官在每個案件審理過程中,必須依據證據資料認定相關事實與適用法條,而法官所為之決定,不因法官個人對當事人或相關案件的喜惡而定,必須依據法律規定而為之[22]。因此法官審理案件時必須保持客觀、中立、公正之立場,但也必須仔細了解、分析及評估相關的細節才能做出正確之判斷。

法官之非核心業務但又與審判相關的部分,係指為確保審判程序順利進行而必須由法官決定或處理的相關事務,如收案後之程序要件審核、排定庭期、簽閱公文、管理或整理卷宗等。法官之核心業務雖為審判,而前述非核心業務但又與審判相關者,實則亦花費法官不少心力與時間處理。有些部分,如卷宗整理或程序要件審核,或可委由具有法學背景或知識之法官助理協助部分內容,然內容仍須經法官與法官助理作進一步的討論才能確認。

最後,與審判無關之非核心業務係指與法院行政管理或其他與法官職務有關之工作項目,如行政事項、督導、管理、教育訓練、財務等。這些項目理論上不一定需要法官親自執行,而是因法官之工作所需,或組織單位中因人員經驗與專業的考量而延伸出之相關業務需求。這部分就與其他行政業務單位有相當的同質性,甚至不一定都需要有法律專業背景的人士來負責。

因此,將法官之業務作以上區分後,我們就會發現提高法官的專業性和提升效率並無本質上的矛盾。因為法官之專業性應該展現在其核心業務,也就是審判整個過程的品質。但是審判品質之提升顯然需要透過法官專業能力之充實加強、法官群體間之經驗分享、法官與社會之對話交流、法學教育理念之傳達以及社會現象脈動之瞭解等方式為之,而此些均需要法官在審判以外投入大量資源與時間。

近年來,司法案件急速增加,法官工作負擔越來越重,如何減輕法官在非核心業務上的負擔,即可能為AI科技於司法著力之處,並可同時確保司法品質與提高司法公信力。此外,法官在其審判的核心業務執行上,往往也需要蒐集、整理與分析大量案件資訊或過往案例,更需要花時間撰寫判決書,處理複雜的法理論述。其中也應該有若干部分可以藉由AI科技來提供更完整的資訊供法官參考。

參、我國法官對於AI科技應用的態度

前文將法官核心與非核心業務所作的區分,並不只是提供AI應用於法官工作上的背景,事實上也影響著法官對於AI科技應用的接受態度。本文作者 (邱筱涵)即曾以學術研究者的身分,在其多達108位的法官問卷中調查法官對於AI科技應用於審判的態度[23],包括科技法庭於審判品質和效率之影響、創新科技或AI協助法官審判之可能性、AI技術運用於判決例稿或判決預測之看法,創新科技是否可能誤導司法審判之了解等等,並且分析創新科技運用與司法改革之間的關聯性。

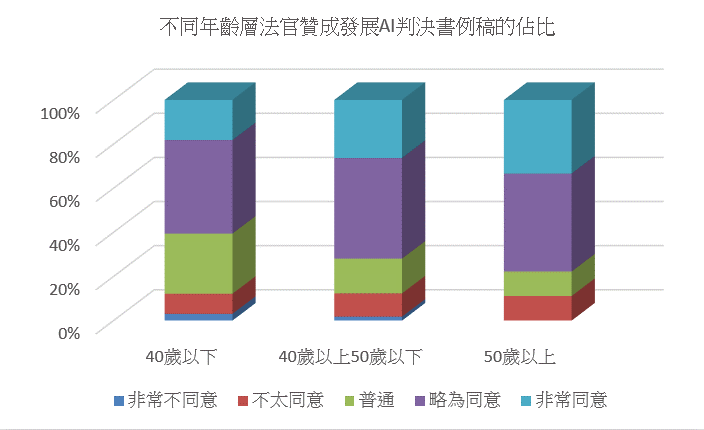

在分析法官性別、年齡、背景與使用現有之創新輔助系統(如量刑資訊系統)之相關經驗後,該研究發現與一般民眾多認為法官思維保守的印象相反,絕大多數法官對於創新科技運用於司法審判持正面肯定態度,且多數法官認為科技法庭有助於提升審判效率與品質[24],並且高達80%以上之法官贊成使用更多資訊或創新科技協助法官審判。更有甚者,大多數的法官對於AI判決預測或AI例稿生成等AI科技於審判的應用,也抱有相當之期待。相關統計可見圖一。

圖一:不同年齡層法官對於AI科技應用於司法審判的問卷調查結果(邱筱涵與宋皇志,見註23)。上圖是對於AI應用於判決預測之贊成度,下圖是對於發展AI判決書例稿的贊成度。此問卷總共調查108位男女各半的法官,其中40歲以下有33位,40歲以上50歲以下有57位,50歲以上有18位。

但是在法官對創新科技的整體正面期待中,該研究最耐人尋味的發現是,年齡較長或資歷較深的法官對創新科技應用於司法審判反而比年齡較低或資歷較淺的法官更有信心。事實上,有不少年齡40歲以下,理應對創新科技更為了解習慣的法官,卻是對於AI科技在司法上的應用更為保留或表達質疑。其中最有爭議的是關於AI應用於判決預測的部分,因為顧慮AI可能未能兼顧個案之特殊性而造成判決預測結果出現偏見或失準,畢竟審判過程並非機械化之決定,應富有更多的人性或溫暖。反之,資深法官可能因為對審判整體有更豐富的經驗,反而能從審判外圍的角度來觀察科技運用於司法所帶來的整體效益,因此比較不會侷限其發展可能性。因此,該研究發現不同年齡層法官對於創新科技應用於司法審判的觀點之所以不同,可能就在於他們對於實際運用時的圖像不同。

此外,該研究也同時發現對於AI 輔助的判決書草稿生成,法官的接受度也受到其如何理解AI運作的圖像影響。例如受訪的法官對於「一鍵式」的AI判決書生成多表示質疑,並不認為判決書的複雜程度能夠透過這種方式有效表達,反而帶來更多錯誤與偏見要後續修改。但是如果是透過法官的引導來用AI逐句生成,加速判決書寫作的速度但表達方向上可以由法官掌握,則能得到法官更多的認同。這顯示討論AI應用於司法審判時,必須有更具體的圖像或實例才能有助於理解法官的態度緣由,以及是否能帶來實質的幫助。

以上所簡述之問卷調查結果,可回應前節將法官之工作內容分為核心與非核心業務的必要性。亦即,關於審判的非核心業務,如資料的蒐集整理或法庭語音轉文字等等,法官的態度顯然是樂於接受的。但屬審判核心之部分,例如事實認定或論罪量刑,大部分法官認為這部分是沒辦法透過AI科技取代的,因為擔心無法考慮到人性的複雜面而給出機械化的結果。但如果將AI應用於審判的圖象更具體化且細緻化,例如是透過人機合作的方式,由AI科技輔助提供相關資訊或提醒不必要的錯誤,但最後仍由人類法官給出最終之判斷與價值選擇,則能夠得到多數法官的接受。但是人類法官對於AI技術所提供的資訊是否採納、採納的程度、以及此些資訊對相關決策整體的影響程度,均值得未來有司法AI系統出現後能夠有更多相關的研究。

肆、ChatGPT的簡要技術說明與三大應用類型

如第一節所提及,近半年在全世界爆紅的ChatGPT是屬於「生成式AI」的對話機器人,已經在各個領域帶來重大的影響[25],也一定會在強調文字語言的法律領域有更大的發揮空間。但是許多對ChatGPT的誤解也是由於不了解其技術基礎,所以本文先簡略介紹其基本訓練與運作模式[26]:

一、 大型語言模型: ChatGPT是源自GPT3.5的大型語言模型(Large Language Model, LLM),以數千億字的海量文字資料來作訓練,主要是計算模擬每個字與前後文其他字詞的統計關係。可以根據提問者輸入的問題來預測各種文字組合出現的機率,將機率最高的結果作為「答案」來提供[27]。雖然ChatGPT因為有大量的文字資料訓練,文字生成相當流利不呆板[28],但其實無法保證這些內容是正確,也因此本質上應該是被當作一個「文字產生器」[29]。許多人卻將之當作搜尋引擎,以為總可以得到正確的資料,其實是誤解。

二、人工回饋的強化式學習: OpenAI並沒有讓GPT的功能停在文字接龍,而是雇用數十位人工標記員耗費一年以上的時間來給ChatGPT的回答作評分[30],讓ChatGPT的文字生成模型再透過強化式學習的方式來強迫自己輸出的結果是符合標記員所認可的標準[31]。經過這樣訓練,ChatGPT就比較不會出現政治不正確或明顯偏見的文字,也讓使用者可以藉由特定的輸入語法作對回應使用更精確的調控,也就是所謂的「提示工程」(Prompt engineering)[32]。

三、使用即時資料反饋訓練: 作為對話機器人,ChatGPT也根據使用者前幾次的提問與回覆記錄當作重新輸入的資料,使其後來的回答可以緊扣著同一個主題發展下去。此種設計就讓ChatGPT可以貼近使用者經驗上的親密感而將對話更加深入精緻,甚至可以能針對不同使用者的需求而有特定的表現方式[33],例如以蘇格拉底的對話模式來深入討論或學習概念[34]。

透過以上簡單的說明,我們就可以了解ChatGPT這類AI機器人與人類說話表意最大不同之處在於,它並非「有意識」地提供「答案」,而只是計算機率並提供某些文字組合作參考。所以ChatGPT產生假資料或假新聞[35]完全是合理的,但是更重要的是該如何正確的使用它。作者(王道維)曾在先前著作[36]中提出,認為應該按照其文字生成的特性,將其應用歸類為三大類型來個別討論,分別是「正確可靠」、「創意豐富」與「方便實用」,但這三者彼此間並非不能共存。

如果將上開功能之特性運用於司法領域,對於「正確可靠」的期待顯然需要更為保守謹慎,因為ChatGPT所產生的文字內容雖然順暢流利,但無法與外界直接確認對應,只能稱作「虛擬知識」[37],而非正確無誤的結果。所以實際使用ChatGPT的時候,在這類的應用上需要法官作人為引導或善用對其多樣結果的選擇權,讓法官可以根據其專業作最後的評估決定。雖然這最後的步驟也需要花時間評估,但是比起目前完全由人為處理顯然還是更為有效率且可以減少人為疏失。

從「創意豐富」的功能論之,我們可以發現此功能與法官工作之內容關聯性較低,因為法官係依法審判,而非以發展法官個人的創意為目的。雖然在某些特殊的案件中,法官的確需要從現在社會既有的框架中,提出超越當代或現狀的理念,希望藉由個案事件的法理論述,來創造未來更好或更值得考慮的判決方向,但是ChatGPT這類發散創意的聯想功能由於無法在訓練資料以外提供新的論理基礎,目前並不適合出現於依法審判之司法文件中。

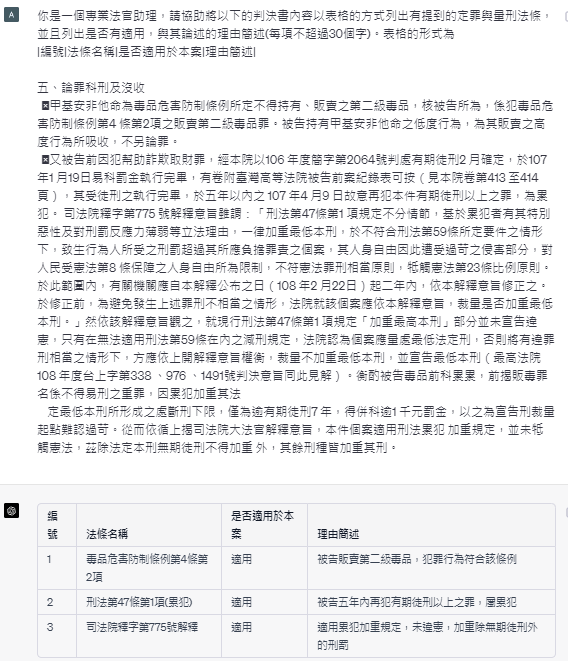

最後,關於「方便實用」的功能,其實是根據現有的資料整理(例如把文章資料蒐集成表格,作文章摘要,或是摘取其中部分的資訊等),此部分比較不涉及審判獨立的司法核心價值,也不會有生成假資料的問題。因此,這可以鼓勵法官或法官助理善用AI工具以減少不必要的文書處理時間,有助於提升法官之工作效率。這部分坊間已經有許多搭配GPT的應用程式出現,或是各類Prompt指令大全等。圖二即為兩個使用ChatGPT整理判決書中相關事實、法律適用或證據來源的例子。這部分的工作其實與一般的行政文書沒有本質上的差異,的確是有機會在主管機關的規劃下作更有全面性的推廣,如新加坡政府宣布與OpenAI合作將全面引入ChatGPT來協助公務員的文書處理[38]。近期國內也有企業宣布投入大型語言模型的開發,當然也為這樣的應用方向預備更多的可能性[39]。

圖二: ChatGPT應用於判決書資料擷取的例子。上圖是請ChatGPT表列出某毒品案件(判決書來源:法源法律網)所提到的法律適用與理由。下圖是請他表列出某詐欺案件(判決書來源:法源法律網)的證據來源。此類資料整理功能可以應用於協助二審法官迅速了解前審判決的重點或證據資料內容,快速整理卷證資料,也能運用於一審法官閱讀律師書狀或檢察官的起訴書內容或為重點整理。

除了以上三大方向的應用分類以外,ChatGPT最重要的特色其實是在於透過語言文字的功能而實現近乎通用型AI的程度[40]。這代表以上這些功能在ChatGPT其實是可以整合的,甚至能夠用來操縱其他形式的AI工具(例如透過文字命令來產生圖片[41])或甚至自動驅動其他的AI程式來完成相關的工作等等,也就是目前最新版的Auto-GPT[42]。也因此建立在ChatGPT上的文書處理助理,如同微軟在Office365上的Copilot[43],也會越來越多。因此可以合理的相信,未來是可以用ChatGPT來建立一個AI助理,協助統合處理更多法官所需要處理的工作內容,並且將其他應用於司法審判的AI工具做更好的整合。

伍、AI 與 ChatGPT 應用於司法審判之原則與條件

綜觀先前幾節的各種分析,有人可能主張所有與法官審判相關的工作,基於審判獨立性、案件複雜性以及判決的人性化因素,應完全避免使用任何 AI 技術。換言之,AI 技術的應用應僅限於與法官審判無關的業務。本文將此觀點稱為「安全保守原則」。

然而,隨著 ChatGPT 等大型語言模型的發展,以及社會對司法判決一致性的期望和司法國是會議對司法資訊建設的要求[44],本文認為 AI 應用於司法領域時,可以採納另一種「審慎積極原則」,概述如下:

在與法官審判相關的核心業務中,應根據具體情況進行有條件的使用。考慮的條件應包括案件的特性與數量、可信賴的AI模型、經過培訓的使用者以及持續性的更新與監督等,這樣才能確保AI在此領域的應用能有效提高審判效率和正確性。對於非審判核心業務,則應更加積極地引入AI技術,以降低整體司法工作負擔。

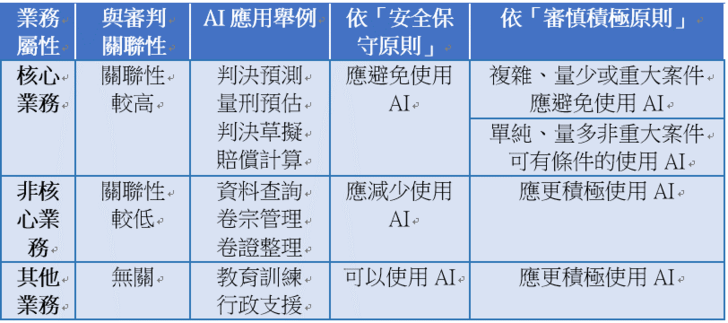

為方便說明與比較,本文將以上兩種原則整理成表一來釐清:

表一:法官工作中依照業務與審判的關聯性而有不同的AI協助處理方式。右側兩欄式按照「安全保守原則」與「審慎積極原則」而列出相關的態度。表中的「有條件的使用AI」請見內文說明。 在比較表一所列出的「安全保守原則」與「審慎積極原則」時,可發現後者明確建議在法官核心業務中「有條件地使用AI」。這些條件至少應包括以下四個方面:

一、 優先在簡單且數量較多的案件中使用AI: 首先,因為AI技術是基於大數據學習,應用於司法領域時也應從相對簡單且數量較多的案件類型開始[45]。例如:刑事案件中的危險駕駛、單一被告的施用、販賣、持有毒品等,或民事案件中的簡易案件如返還借款要求、事實較為單純的侵權行為(如車禍案件)等。然而,對於資料量明顯較少且難以訓練AI的案件,例如較為複雜、特殊或重大的案件(如殺人、貪污或金融案件、工程事件、土地分割等),應讓法官針對個案特殊性進行更細緻的評估,避免干擾。只要前述類型案件能有效減少法官工作時間,應能讓法官將心力投注於後者,從而間接提升整體的審判效率。

二、推廣開發「可信賴的AI」: 一般人受到新聞媒體的影響,認為AI可以超越人類判斷能力,甚至取代人類法官。然而,對於訓練資料來自人類社會的數據,其準確性仍然由人類自身決定,因此AI不可能超越人類法官而更加公平正義[46]。因此,「無誤或無偏見的司法AI模型」是基於對AI的誤解而甚至是錯誤的期待。更有意義的目標應該是,即使司法AI模型可能出錯,其錯誤率是否在可接受的範圍?是否具有透明性讓問題可以被發現?並具有可解釋性以便調整修正?整體而言,也就是AI是否可被合理信賴的問題。

因此,本文提出的「審慎積極原則」需要有計劃地推動所謂「可信賴的AI(Trustworthy AI)」的發展。根據歐盟議會的定義[47],可信賴的AI包含七大方面:1.人類自主性和監控(Human agency and oversight)、2.技術穩健性和安全性(Technical Robustness and safety)、3.隱私和資料治理(Privacy and data governance)、4.透明度(Transparency)、5.保持多樣性、不歧視和公平(Diversity, non-discrimination and fairness)、6.社會和環境福祉(Societal and environmental well-being)、7.問責制(Accountability)。其中最重要的是第一項自主性與監控性,最簡單的實踐方式是至少提供多種AI模型設計,讓法官有所比較參考,以減少特定AI偏見問題。當然,各種AI模型應提供資料來源、演算法特色與侷限性、準確率與資料更新頻率等供法官參考,以符合透明性與問責制等原則。

三、 AI使用者需要接受基本訓練: 由於所有AI模型都是將資料經過特定形式進行訓練和表達,因此使用這些AI模型的法官或法官助理也需要接受基本訓練,以正確解讀結果。例如,判決書雖有一定體例,但仍因法官個人習慣而有結構差異。若開發AI輔助的判決書撰寫系統,可能會對判決書結構有所規範,部分法官可能感到不適應。若使用者錯誤使用AI,當然也會影響其效能,因此應用AI模型也應考慮使用者的經驗與學習過程,以發揮最大效用。

四、AI系統需要持續檢視與更新: 儘管AI科技在商業和社會上已成風潮,但相關技術仍在不斷發展,故需持續檢視與更新。例如,新案件可能因修法或社會價值觀改變而有不同標準,因此審判AI系統需能更新,包括訓練資料和AI模型演算法。對AI的持續檢驗與更新有助法官在使用AI時同步被提醒或調整標準,減少後來又因為個案而直接侵犯人類法官獨立審判的疑慮。

綜上所述,將AI應用於司法實務領域並非僅購買技術或模型後即可使用,而需要整體配套措施將司法需求與AI技術更好地結合,以避免產生AI在司法應用中的敏感性和爭議性可能帶來的問題。正如第三節所述,大多數法官對於AI科技在審判中的應用抱有正面期待,但並不願完全任由AI決定使用結果。因此,未來在審判中應用的AI設計應朝向人機合作的方向發展,使AI永遠成為法官的輔助工具。當然,這條道路並非一蹴可及,但仍可逐步建構出新的機會與發展。

陸、若干應用於司法審判之「可信賴的AI」雛型

本節將嘗試提出一個具體可應用於司法審判的「可信賴的AI」雛型,說明如何避免對法官獨立審判的侵害。由於作者並不了解其他研究者在類似計畫中的細節(涉及研究或商業機密),因此僅以作者(王道維)參與過或正在進行的計畫作為例子。需要注意的是,這裡舉出的例子不一定都有完整的產品,有些可能只是雛形或概念性架構,並且仍有很多改善空間和相關配套需要努力。

一、 親權酌定預測系統: 本文作者曾於2019年與合作者開發了AI輔助親權酌定裁判預測模型[48]。該模型的資料來源為家事法庭的離婚後親權酌定裁判書,經過法律專業標註作為特徵資料輸入,用於在父母雙方都有意願爭取親權的情況下,法官裁判未成年子女的親權歸屬。相較於過去將父母性別作為輸入資料的做法[49],該系統在訓練過程中依據裁判書中的「申請方/相對方」進行標註,而非僅根據「父親/母親」的一般習慣,以避免性別偏見的產生。

圖三:預計2023年7月份更新的AI輔助親權酌定預測系統首頁,可使用三種輸入模式來測試結果。友善資源連結雖然與法官的審判沒有直接關係,但是卻可能在開放給民眾使用時能提供相關資源協助離婚後的家庭運作。

在實際部署階段,系統特別通過加倍資料量並交換申請方與相對方輸入欄位來平衡訓練資料,確保網頁使用者填寫父親或母親欄位時不會影響預測結果。而預計2023年7月更新的版本中,使用者可以用三種不同的模式輸入父母雙方相關因素(每種模式都有其特色與優缺點:選項模式方便輸入,文字模式方便細節描述,選項與文字同時使用則有最佳的預測準確度)。更重要的是,每種輸入模式又都至少有2種以上的AI模型提供不同的預測結果。此種避免性別偏見的資料標註方式、使用非單一模型將計算結果並呈,且以資料擴增(data augmentation)技術用於平衡已知的資料偏差[50],符合歐盟議會「可信賴的AI」中「保持多樣性、不歧視和公平」的原則。

此處需要說明的是,雖然目前最佳的三分類模型(包括父親獨任、母親獨任和共同親權)之預測準確率可達90%,但個案的確有可能在不同AI模型得到差異較大的結果。這可能意味著該個案較為複雜,不應僅依賴單一AI預測結果。反之如果預測的結果具有高度一致性,則可認為該結果具有參考價值。未來將繼續規劃與ChatGPT的文字生成技術結合,以便讓不熟悉法律術語的民眾獲得更佳的使用體驗。

二、評價型量刑資訊系統: 本文作者於2021年參與司法院刑事廳的研究案,開發評價型AI輔助量刑資訊系統[51],應用於槍砲彈藥、妨害性自主及毒品相關案件。與過往量刑資訊系統的差異在於,此系統利用AI辨識標註過往判決書中的法定加重減輕條款,以及與刑法第57條相關的量刑審酌事項,並對後者的評價進行有利於被告與否的標註與統計。儘管AI標註準確度超過90%,使用者仍可透過回報機制進行修正。此AI技術在量刑過程中的應用並非直接預測量刑結果,而是呈現本已存在的量刑分布供法官參考,將AI侵犯法官獨立審判之疑慮降至最低[52],符合歐盟議會「可信賴的AI」中「人類自主性和監控」原則。

此系統清楚列出最常見的量刑審酌事項,將較少見的審酌事項整合,旨在提升法官使用體驗並減少依據個案或少數情況下的量刑結果。相關設計理念均呈現在該系統之使用說明中(例如法定加重減輕條款的出現比例[53],以及量刑審酌事項的出現比例[54]),以提高系統運作的透明度。然而,由於開發時間與資源限制,目前尚未加入與犯罪事實相關的查詢選項[55]。然而,司法院同時更新過往「事實型」的量刑資訊系統,讓法官在量刑時至少具有兩種不同的參考方式[56]。

圖四:評價型AI輔助量刑資訊系統截圖畫面。此為違反毒品危害防制條例第4條第2項之量刑分布結果,設定之量刑條件為被告符合刑法第47條第1項累犯而加重之情形,但犯罪後態度良好(其他因素暫不考慮)。

三、人機協作的判決書生成: 儘管文字生成是ChatGPT的強項,但將判決書全部內容輸入(如:當事人相關個人資料等)難免會引發法院資料外洩的疑慮[57]。因此,本文建議使用OpenAI開放的應用程式介面(Application Program Interface, API)協助訓練另一個外掛AI模型。通過結合ChatGPT的提示工程(Prompt Engineering)與外掛式AI模型,法官僅需輸入開頭部分文字,即可讓AI生成後續可能的文字選項供法官參考或進行修改。AI系統將重複輸入修改後的句子並繼續提供新的句子選項,直至判決書完成。

相較於「一鍵式」判決書生成,上述架構透過逐句生成,讓法官能即時將想法轉化為文字。這種人機緊密互動的生成模式讓法官更安心(見第三節),因為能完全主導判決書的寫作過程,同時快速完成所需表達的內容。結合不同案件所需模板架構,系統可即時檢查判決書是否提供足夠的量刑因子描述或相關重要資料,讓整個判決書在完成時已具結構化整理,符合歐盟議會「可信賴的AI」中「人類自主性和監控」、「技術穩健性和安全性」及「隱私和資料治理」的原則。

本文以三個具體實例或概念說明,即使涉及審判核心的判決、量刑或判決書撰寫,仍可開發「可信賴的AI」,讓法官降低受AI偏見影響,提高司法效能。然而,這些實例並非完美無瑕,而是展示「可信賴的AI」設計不僅涉及AI技術,還需司法實務領域積極參與以進行周詳規劃與設計。在此基礎上,可透過以ChatGPT為基礎的人機介面,串接各類AI應用,整合成可靠且更具人性化的AI助手,以滿足法官審判業務的高品質需求。

柒、司法AI的結構性困境與公共化AI的解方

在我國司法實務上,AI相關應用仍處於初步階段[58],因此許多公共性與社會性層面的角度往往僅集中於隱私、偏見、歧視與人權等議題,也比較容易忽略實際執行本身的結構性困境,需要我們更加關注與思考。本文首先概述開發在地化司法審判應用所面臨的挑戰,再從「公共化AI」的角度提出具體建議以供相關單位參考。

首先,在技術層面,法律領域對文字資料的精確性要求遠高於一般民眾的需求(如網路文字)。儘管ChatGPT的出現為AI技術在文字處理方面帶來了新的可能性,但訓練和運作如此大型語言模型所需的經費和資源已超出單一企業、學術或政府機構所能承擔的範圍。因此,在司法領域中應用AI需要詳細的規劃和充足的資源,間接也提高了技術和經費門檻。

然而,在政策層面,人文社會學界普遍關注AI帶來的負面影響(如偏見、歧視、隱私、人權、資源分配等),進而使司法領域的主責單位難以進行更開放和積極的研究投資。此外,在產業層面,由於司法AI的使用者相對較少,且資料隱私和技術智慧財產權問題限制了其商業價值,民間企業更可能乾脆將其順序置於其他領域之後,讓司法相關的應用更不容易找到技術支援。在這三個環節(技術、政策與產業)相互牽制的情況下,形成了一種僵化的結構性困境,限制了我國司法AI化的進程。

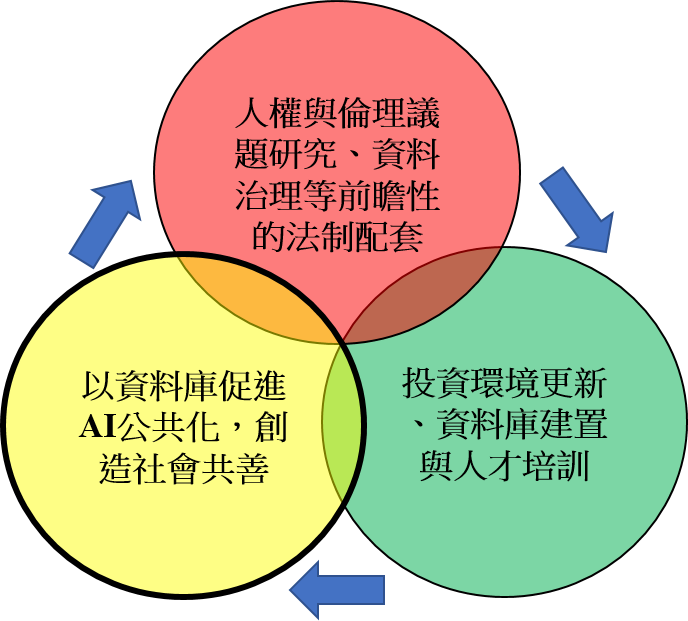

對於這樣的情況,本文認為現階段應該可以參考「公共化AI」的進路[59]來有所突破(見圖四):藉由結合政府的政策引導、研究經費與學界的跨領域團隊,將政府的公共資料庫作系統性標註而導入AI技術[60],發展對於社會大眾有重要公共利益的AI應用系統,以確保社會大眾的整體利益不會在這波AI發展中被以商業模式推動的「AI資本化」所犧牲。而這些公共資料的標註結果與技術公共化可帶動政府的資料治理與對AI發展有更成熟的配套[61],間接帶動相關產業投資與人才培育。

圖五:公共化AI的推動,首先須要從政府資料庫(在本文中即司法領域的相關資料)進行結構化的標註,推動AI相關的公共應用,然後帶領業界投資人才與技術,促進更多公共化的應用發展與相關環境法規的配套。(圖片來源於註61)

將以上「公共化AI」的概念應用於司法領域,特別是與司法審判相關的AI應用,本文建議可以分三個階段進行:

第一階段,主管機關邀請具有技術和法律背景的學者以及司法實務界人士共同執行研究計畫,評估哪些司法相關案件或資料庫具有開發AI應用的價值,媒合司法人員最迫切的需求。這一階段類似於建築設計過程,運用成熟的AI技術評估相關的「可信賴AI」可以作到甚麼程度。這個相對經費不高的規劃階段有助於司法單位增加對AI應用的具體想像,讓技術端更貼近實際需求,也讓法律端先準備好相關的法令配套,減少彼此間因為想像落差而有的誤解。

第二階段,主管機關根據第一階段規劃設計的方案,以標案或研究案的方式委託適合的民間或學界單位進行實質開發。由於已有前期研究,此階段的目標功能和實際應用場景會更明確,降低廠商開發的風險,並使司法單位更有時間進行相關配套措施和預算規劃。原先的設計規劃團隊可以轉作為專業監督團隊,協助政府或司法單位有效掌握相關進度和成果,避免外行領導內行。

第三階段,將開發完成的AI系統具體實施,積極培訓司法人員使用,甚至納入司法官學院的相關課程。同時,制定相關的法令規範以確保司法AI在使用過程中可以融入標準流程,並擴大附加應用的範圍。如此,整體經濟規模將穩定擴大,吸引更多企業參與相關發展,形成良性競爭與豐富的生態圈,推動AI技術和人才的穩定發展,實現良性循環(見圖四)。

經過這三階段的規劃和投資,後續AI系統開發和各種應用將更加精確到位,也能逐漸降低司法人員與大眾對AI的疑慮。隨著更多政府資料在適當規範下逐步公開,這類AI的公共應用、開發流程和相關配套就能納入政府的常態滾動式規劃,也必然吸引產業界與學界持續投入,化解前述結構性僵局。因此推動AI於司法的應用不是短期經費投注或是只限於司法領域就能成功的,反而需要有前瞻的規劃並持續穩定的擴大投資,才能看到各種成熟應用伴隨技術更新不斷出現,成為推動司法革新的一股重要力量。

捌、未來展望:可靠的AI助理

本文旨在從多個角度深入探討如何運用「審慎積極的原則」,將AI技術應用於司法審判的工作中,使「可信賴的AI」成為法官實務工作上的助理。這位AI助理可以協助減輕法官非核心業務的壓力,同時提高審判核心業務的效能,但不會侵害法官的審判的獨立性。要實現這一個看起來很科幻但也越來越有可能的目標,我們需要仔細區分法官各種審判業務的內涵,考慮其主觀經驗和感受,了解AI技術的特點,不同案件的性質,並從政策、產業與技術角度一同推動公共化AI的生態圈,才能有越來越多的「可信賴的AI」出現,協助我們更加清晰的評估成效和檢視相關政策。最後就可以藉由目前最接近通用型AI的ChatGPT(或許未來還有更好的其他產品)來串連這些應用,使之更能體貼法官的需求而完成高品質的任務,成為法官的助理。畢竟,隨著近年生成式AI的快速發展,各種如隱私、人權、偏見、歧視和資源分配不平等的社會問題只會更為增加繁雜,司法單位自然也需要提升效能才能積極應對。所謂「以子之矛,攻子之盾」,也許法官未來最可靠的戰友將是這位正在敲門拜訪的ChatGPT,與之共同面對這個已經來臨且更需要公平正義彰顯的AI時代。

附錄:ChatGPT參與本文寫作的方式

本文明列ChatGPT為共同作者,不僅是因為文章中有展示其功能,而且實質參與了全文的寫作過程。王道維和邱筱涵兩位人類作者使用了ChatGPT來完成本文的流程略述如下。 1. 人類作者先討論寫作方向,給ChatGPT若干關鍵字來生成一份文章大綱。 2. 在調整大綱以更符合期望後,人類作者再利用ChatGPT針對每個大綱標題生成約300字的初稿,以檢驗內容是否符合人類作者的規劃。 3. 使用GPT4為基礎的New Bing搜尋引擎對每段初稿進行改寫,並提供相關文獻資料作為補充參考資料。 4. 人類作者根據ChatGPT初稿和New Bing提供的參考文獻內容,結合作者過往的研究、著作與閱讀過的文獻資料,進行概念補充與文字修補,形成更完整的論述。在此過程中,人類作者的文字逐步取代ChatGPT初稿中的文字。 5. 由於本文字數較多,雖然可以透過指令由ChatGPT生成摘要,但效果欠佳。所以人類作者改以將文章各節先提出幾個關鍵鑰句,直接送入ChatGPT,請其生成300字左右的文章摘要。選擇最好的版本作為本文摘要。 6. 在文章完成後,再次利用ChatGPT對各節進行改寫:設定其身分為同時了解AI技術與熟悉司法實務的學者,指令要求在不影響整體架構的前提下,協助修改文章中語意不夠通順的地方並刪減重複的語句。 7. 人類作者在檢查全文內容並作若干必要的修補確認後,提交投稿。 [1] 國立清華大學物理系教授與通識教育中心合聘教授、國立清華大學諮商中心主任、國立清華大學人文社會AI應用與發展研究中心副主任。E-mail:dwwang@phys.nthu.edu.tw。 [2] 臺灣高等法院刑事庭法官、國立政治大學科技管理與智慧財產研究所博士生、前司法院刑事廳調辦事法官。E-mail:chiumaggie0109@gmail.com。 [3] 美國OpenAI公司開發之大型語言生成模型(Large Language Model)。本文所使用的ChatGPT包含GPT-3.5、GPT-4與使用GPT-4為基礎的搜尋引擎New Bing。網址:https://chat.openai.com/,最後瀏覽日期:2023年5月15日。 [4] 生成式AI是AI眾多演算法之一。以ChatGPT為例,是負責將輸入的文字資料轉換成另一些文字資料輸出,但後者的輸出可以是前者的對話、翻譯、查詢、延伸、歸納、摘要、解答等等各種不同的關係。而其他種的生成式AI可能以圖像轉圖像,或以文字與圖像之間互換,或其他更多如文字、影像、語音、影片、行動等等各種資料模態間的轉換生成。即使同樣功能的生成式AI也會因為訓練資料與模型設計的不同而有相當大的差異。 [5] 通用型人工智慧(或另稱為強AI)是指可以在相當廣的範圍內處理各種類型的資料或功能,彷彿人類大腦所能作的許多不同工作。ChatGPT若限制在文字資料的範圍,可以算是當前最接近這個概念的AI產品。目前其餘的AI產品都比較明顯只能應用於特定的範圍,屬於弱AI。 [6] 可參考〈GPT-4 如何輾壓現有人工智慧,讓 Google 眼前一黑?〉,科技新報(3/15/2023)。引用網址:https://technews.tw/2023/03/15/openai-gpt-4-power/,最後瀏覽日期:2023年5月15日。 [7] 可參考 GPT-4登場!OpenAI這次新增哪些功能?與GPT-3.5差異一次看,商業週刊(3/15/2023)。引用網址:https://www.businessweekly.com.tw/focus/blog/3011904,最後瀏覽日期:2023年5月15日。 [8] ChatGPT本來有個重要的缺陷在於其訓練資料只及於2021年9月,無法正確回答那之後的相關時事議題。但是今年(2023)5月15日開始已經可以連線,並且開放外掛程式的使用。相關報導可見於,ChatGPT 連網功能正式上線了!Plus會員如何開啟、好不好用、回答的內容正確嗎,T客邦(5/18/2023),最後瀏覽日期:2023年5月18日。 [9] Google攔胡微軟!Google文件、Gmail導入AI,可以自動寫草稿⋯還有哪些亮點?,數位時代(3/15/2023)。引用網址:https://www.bnext.com.tw/article/74443/google-googledoc-gmail-generatedai? ,最後瀏覽日期:2023年5月15日。Google全面反擊戰!Bard全面開放,整合旗下各類服務,部份能力超越GPT-4,電腦王(5/11/2023),最後瀏覽日期:2023年5月18日。 [10] 微軟震撼推出Copilot,Word、Excel、PPT用法全AI化!為何說Copilot像《鋼鐵人》Jarvis?,數位時代 (3/17/2023)。引用網址:https://www.bnext.com.tw/article/74474/microsoft-m365-copilot-generatedai,最後瀏覽日期:2023年5月15日。 [11] 大核彈降臨:GitHub 推出Copilot X,有 GPT-4 讓人直接用「嘴」寫程式碼,Inside (3/23/2023)。引用網址:https://www.inside.com.tw/article/31101-github-copilot-x-gpt-4-code-chat-voice-support,最後瀏覽日期:2023年5月15日。 [12] 陳誌雄、楊哲銘與李崇僖,人工智慧與相關法律議題,元照出版,1版,2019年9月。 [13] 龍建宇與莊弘鈺,人工智慧於司法實務之可能運用與挑戰,國立中正大學法學集刊,62期,2019年1月。 [14] 王紀軒,人工智慧於司法實務的應用,月旦法學雜誌,293期,2019年9月。 [15] 蕭奕弘,人工智慧之新發展與在司法實務上之應用,檢察新論,25期,2019年2月。 [16] 如美國著名的Loomis v. Wisconsin案以及Malenchik v. State案。 [17] AI人工智慧會威脅人類生存? 中研院李建良告訴你!,人文.島嶼 (3/31/2020)。 引用網址:https://humanityisland.nccu.edu.tw/lee_jianliang01/,最後瀏覽日期:2023年5月15日。 [18] 〈AI倫理準則及其對臺灣法制的影響〉,臺灣人工智慧行動網 (3/3/2021) 。引用網址: https://ai.iias.sinica.edu.tw/ai-ethics-guidelines-in-taiwan/,最後瀏覽日期:2023年5月15日。 [19] 林清汶,法律對於人工智慧科技之影響與規範,萬國法律,233期, 2020年10月。 [20] 吳維雅,生成式AI的善與惡(三):建制AI規範的可行方向,聯合報鳴人堂(5/11/20203),https://opinion.udn.com/opinion/story/120817/7157540,最後瀏覽日期:2023年5月19日。 [21] 即使是ChatGPT的執行長也認為應該要對大型語言模型的使用進行監管,大語言模型要憑證才能開發?至少 OpenAI 這樣建議監管者,科技新(5/18/2023),https://technews.tw/2023/05/18/openai-calls-on-governments-to-create-ai-regulation/TechNews,最後瀏覽日期:2023年5月19日。 [22] 《法官倫理規範》第二條規定:「法官為捍衛自由民主之基本秩序,維護法治,保障人權及自由,應本於良心,依據憲法及法律,超然、獨立從事審判及其他司法職務,不受任何干涉,不因家庭、社會、政治、經濟或其他利害關係,或可能遭公眾批評議論而受影響。」第四條規定:「法官執行職務時,不得因性別、種族、地域、宗教、國籍、年齡、身體 、性傾向、婚姻狀態、社會經濟地位、政治關係、文化背景或其他因素,而有偏見、歧視、差別待遇或其他不當行為。」 [23] 邱筱涵、宋皇志,法官採納創新系統之詮釋研究—─以量刑系統之採納為例,2022年第16屆全國科技法律研討會論文集,頁465至490。 [24] 目前確實已有許多科技應用於司法審判實務,例如:電子卷證提示、語音辨識系統製作筆錄或判決,以及AI輔助的量刑資訊系統。 [25] 以教育領域為例,可參考,禁了也沒用,美大學開始改變教學方式研究怎麼與ChatGPT 共存、又不用擔心學生抄襲,36氪(1/31/2023)。引用網址:https://www.techbang.com/posts/103356-chatgpt-is-coming-american-universities-are-beginning-to,最後瀏覽日期:2023年5月15日。 [26] 以下的段落摘錄於王道維,當Google遇上ChatGPT──從語言理解的心理面向看AI對話機器人的影響,風傳媒(2/11/2023)。引用網址:https://www.storm.mg/article/4725780?mode=whole,最後瀏覽日期:2023年5月15日。後來增補的版本亦可直接見於作者王道維的部落格原文:https://blog.udn.com/dawweiwang/178350327,最後瀏覽日期:2023年5月15日。 [27] 關於AI如何處理人類語言的工作,統稱為「自然語言處理」(Natural Language Processing),可以說是當前最富挑戰性也最有未來性的AI應用。對這主題有興趣者可以參考作者王道維為國科會人文處所拍攝的「人文社會AI導論課程」第七集,「自然語言處理簡介」(2021)。影片網址: https://www.youtube.com/watch?v=7UnqS4yajJc&list=PL_qamH512zu6NbUEDShUFyHiE7qHUGJiN&index=7,最後瀏覽日期:2023年5月15日。 [28] 李宏毅,「Putting Words into Computer: Introduction to ELMO, BERT and GPT」,機器學習課程(2019)。引用網址:https://www.youtube.com/watch?v=UYPa347-DdE&list=PLJV_el3uVTsOK_ZK5L0Iv_EQoL1JefRL4,最後瀏覽日期:2023年5月15日。 [29] 極力擺脫假新聞與歧視言論陰霾,OpenAI 推出商業化文字產生器,科技新報(2020/6/14)。引用網址:https://technews.tw/2020/06/14/openais-text-generator-is-going-commercial/,最後瀏覽日期:2023年5月15日。 [30] 關於人工配合訓練ChatGPT的部分,可以參考以下稍微詳細一些的說明:ChatGPT 為何能像人類對談?台大資工陳縕儂教授揭 AI 模型背後的訓練原理,Inside (12/26/2022)。引用網址:https://www.inside.com.tw/article/30190-chatgpt-professor-Vivian-Chen-interview,最後瀏覽日期:2023年5月15日 [31] 李建興,OpenAI改進GPT-3使其更能聽懂人類指示,並減少輸出有毒內容,iThome (1/28/2022)。引用網址:https://www.ithome.com.tw/news/149140,最後瀏覽日期:2023年5月15日 [32] 事實上,網路上已經有許多人提供所謂的「ChatGPT指令大全」之類的資訊,方便使用者用特定的提問方式,來讓AI做出更符合其要求與期待的工作。例如讀者可以參考以下網頁:ChatGPT 指令大全https://www.explainthis.io/zh-hant/chatgpt,最後瀏覽日期:2023年5月15日 [33]《雲端情人》真實版!測試ChatGPT「虛擬情人」隱藏功能,遠見雜誌 (3/9/2023)。引用網址:https://www.gvm.com.tw/article/100454,最後瀏覽日期:2023年5月15日。 [34] AI 老師真的來了!可汗學院用 GPT-4 幫助教與學,翻轉教育 (3/27/2023)。引用網址:https://flipedu.parenting.com.tw/article/008185,最後瀏覽日期:2023年5月15日。 [35] 微軟已經將ChatGPT與搜尋引擎Bing結合起來,稱作New Being,就可連線網路作即時訓練並將這些搜尋到的資料作通順的整理表達,未來的確可能挑戰目前Google網路搜尋的霸主地位。只是因為使用於New Bing的GPT4的訓練方式有所不同,也容易受到網路新資料的干擾,所以更容易出現許多AI幻覺或激烈言詞,使得微軟不得不限制一串對話的次數。可參考以下新聞報導:致命傷出現?微軟承認新版Bing缺陷:聊天太久AI會生幻覺,自由時報(2/17/2023)。引用網址:https://3c.ltn.com.tw/news/52236,最後瀏覽日期:2023年5月15日。 [36] 王道維,迎接「後知識時代」的來臨---從生成式AI的虛擬知識談起,風傳媒(3/31/2023)。引用網址:https://www.storm.mg/article/4766772?mode=whole,最後瀏覽日期:2023年5月15日。 [37] 同前註。 [38] 新加坡政府:正準備導入 ChatGPT,幫公務員寫報告!,Inside (2/16/2023)。引用網址:https://www.inside.com.tw/article/30754-SINGAPORE-civil-servants-to-soon-use-chatgpt-to-help-with-research-speech-writing,最後瀏覽日期:2023年5月15日。 [39] 強化繁體中文!華碩發表「福爾摩沙大語言模型」,Newtalk新聞 (5/17/2023),https://newtalk.tw/news/view/2023-05-17/871594,最後瀏覽日期:2023年5月19日。 [40] 王道維,當Google遇上ChatGPT──從語言理解的心理面向看AI對話機器人的影響,風傳媒(2/13/2023)。引用網址:https://www.storm.mg/article/4725780?mode=whole,最後瀏覽日期:2023年5月15日。若干文字修補更新亦可見於王道維本文本文的部落格原文:https://blog.udn.com/dawweiwang/178350327,最後瀏覽日期:2023年5月15日。 [41] 例如可以用ChatGPT產生特別適合Midjourney的提示文字。可參考Esor Huang,我如何訓練 ChatGPT 撰寫 Midjourney 提示語?AI 繪圖四個階段,電腦玩物(4/16/2-23)。引用網址:https://www.playpcesor.com/2023/04/chatgpt-midjourney-ai.html,最後瀏覽日期:2023年5月15日。 [42] ChatGPT升級了?Auto-GPT為何成最新AI神器?,遠見雜誌(4/14/2023)。引用網址: https://www.gvm.com.tw/article/101720,最後瀏覽日期:2023年5月15日。 [43] 同註9。 [44] 可見於106年司法改革國是會議第四分組:參與、透明、親近的司法。引用網址:https://judicialreform.gov.tw/Resolutions/Form/?fn=51&sn=0&oid=6,最後瀏覽日期:2023年5月15日。 [45] 至於如何區別哪些案件屬於單純/複雜或甚至少數/多數類型,則需由司法單位內部先為適當之討論與篩選,並與技術端進行可行性評估。 [46] 可以參考王道維本文為國科會人文社會研究中心所拍攝的一系列「人文社會AI導論」線上課程。影片參考網誌:https://www.youtube.com/playlist?list=PL_qamH512zu6NbUEDShUFyHiE7qHUGJiN,最後瀏覽日期:2023年5月15日。 [47] 歐盟議會發布《可信賴人工智慧倫理準則》,財團法人資訊工業策進會科技法律研究所。引用網址:https://stli.iii.org.tw/article-detail.aspx?no=64&tp=1&d=8248,最後瀏覽日期:2023年5月15日。 [48] 相關報導可參考例如Taipei Times: Program predicts child custody battle outcomes:http://www.taipeitimes.com/News/taiwan/archives/2019/09/21/2003722662,最後瀏覽日期:2023年5月15日;中國時報:監護權怎麼判人工智慧神預測https://www.chinatimes.com/newspapers/20190921000590-260107?chdtv,最後瀏覽日期:2023年5月15日;聯合報:AI能斷家務事?清大首開發監護權判決預測系統https://udn.com/news/story/6928/4058216?from=udn-relatednews_ch2,最後瀏覽日期:2023年5月15日。 [49] 黃詩淳,邵軒磊,人工智慧與法律資料分析之方法與應用:以單獨親權酌定裁判的預測模型為例,台大法學論叢,48卷4期,2019年12月,頁2023-2073。 [50] Ya-Lun Li, Yun-Hsien Lin and Daw-Wei Wang, Method for Training Decision-Making Model with Natural Language Corpus, US Patent Approved, Application, No.16/875636。李亞倫、林昀嫺與王道維, 「自然語言語料用於機器學習決策模型的訓練方法」, 中華民國專利通過, 申請案號 108146882 [51]由於此系統目前僅開放給法官使用,尚未對外公開。相關資訊可參考司法院新聞稿:「因應國民法官新制,司法院啟用AI量刑資訊系統--具備二種模式、擁有四大優點」,2023年2月6日。司法院新聞稿網址:https://www.judicial.gov.tw/tw/cp-1887-806741-d6471-1.html,最後瀏覽日期:2023年5月15日。 [52] 文家倩,量刑與AI的交會──淺談司法院量刑資訊系統的革新,當代法律,10期,2022年10月,頁12。引用網址:https://www.themislaw.tw/gogofinderReader/index.php?bid=92&p=8#page/8,最後瀏覽日期:2023年5月15日。 [53] 以違反毒品條例的案件為例,在加重法條部分提到最多且適用的是刑法第47條第1項,高達24.70%。其次是兒童及少年福利與權益保障法第112條,僅約1.75%。其他加重法條幾乎沒有提到,所以會合併在「其他較少見的加重法條」中。相較起來,減輕法條最常被提到且適用的,依次是毒品管制條例第17條第2項(84.72%)、刑法第25條第2項(57.39%)、刑法第59條(17.59%)、毒品管制條例第17條第1項(15.66%)與刑法第18條第2項(8.67%)。除上述之條文,其他條文則特別少見,因此合併在「其他較少見的減輕法條」中。 其他相關細節可參考司法院量刑資訊系統(評價型)中的毒品相關案件中之系統說明內容。 [54] 以違反毒品條例的案件為例,在刑法第57條之量刑審酌事項,提到最多次之事項集中在「犯罪後之態度」、「犯罪所生之危險或損害」與「犯罪行為人之品行」。此三項對被告有利或不利的比例上都超過全體的90%,代表此為法官於量刑審酌事項經常考量的因素。「其他審酌事項」包括刑法第57條中其他各款。特別的是,「犯罪動機與目的」雖也常被法官提到,但超過95%的案件都只有給中性評價,所以不需要另行區分單獨的選項以增加法官使用時的有效性。其他細節可參見司法院量刑資訊系統(評價型)中的毒品相關案件之系統說明內容。 [55] 此處本文本文須說明的是,相關的犯罪事實(例如槍枝的數量)對於量刑雖屬重要因子,但幾乎也都反映在量刑審酌事項的評價中(如犯罪所生之危險與損害)。倘未經系統性的量化統計研究,了解該如何有意義的被歸類(例如販賣5把槍與3把槍是否有實質的差異),可能反而會將此與量刑審酌事項重複評價或會產生互相干擾的問題。 [56] 同註55。 [57] 在企業運用中,有機密洩漏之情形發生,此可見相關新聞:三星開放工程師運用 ChatGPT 未滿月就出事,爆 3 起機密洩漏事件…,電腦王阿達 (4/10/2023)。引用網址: https://www.kocpc.com.tw/archives/487553,最後瀏覽日期:2023年5月15日。 [58] Lawsnote法律科技觀察報告 (2020),引用網址:https://blog.lawsnote.com/2021/03/legaltech2020/,最後瀏覽日期:2023年5月15日。 [59] 可參考:王道維與林昀嫺,如何用AI創造社會共善?──AI公共化的契機,台灣人工智慧行動網 (8/14/2020)。引用網址:https://ai.iias.sinica.edu.tw/how-to-create-common-good-in-society-with-ai/,最後瀏覽日期:2023年5月15日。 [60] 林文源、王道維,淺談AI時代的台灣優勢與發展策略,風傳媒(2/22/2023)。引用網址:https://www.storm.mg/article/4738337?mode=whole,最後瀏覽日期:2023年5月15日。 [61] 亦可參考王道維本文為國科會人文處所拍攝的「人文社會AI導論課程」第十集,「AI公共化的願景」(2021)。影片網址:https://www.youtube.com/watch?v=sWLNO_31DBo&list=PL_qamH512zu6NbUEDShUFyHiE7qHUGJiN&index=11,最後瀏覽日期:2023年5月15日。 |

|

| ( 知識學習|科學百科 ) |