字體:小 中 大

字體:小 中 大 |

|

|

|

| 2023/04/08 20:00:00瀏覽272|回應1|推薦13 | |

|

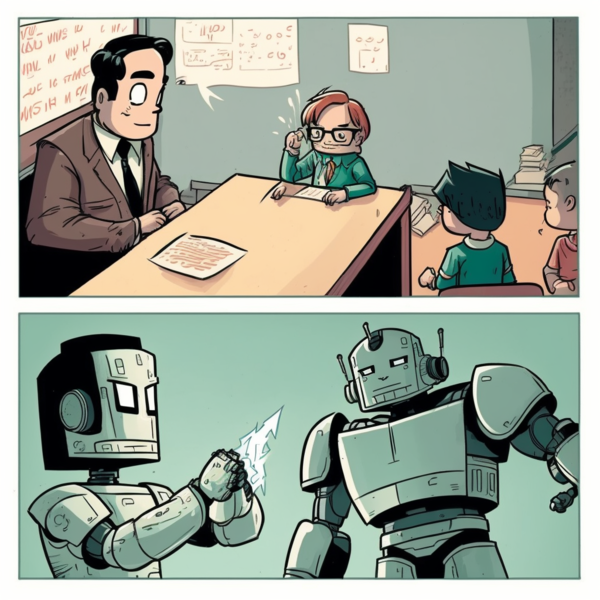

近兩個月來ChatGPT的話題席捲所有社群媒體,連漂亮美眉和假新聞都得靠邊站。在對人工智慧的驚歎和禮贊聲中,打工族視之為洪水猛獸,將取代人類所有的工作;躺平族視之為救世主降臨,將取代人類所有的工作;教育界視之為伏地魔,將無法分辨學生與機器人的作業;業界老闆視之為石中劍,在激烈的競爭中無堅不摧。

其實這種感覺不陌生,就像上世紀初期,人類看待剛出世的汽車一樣:與其和汽車賽跑,不如學會開車。2016年阿爾法狗打敗了世界冠軍之後,圍棋界也深切體會到,與其和AI對弈,不如利用AI探索圍棋。

首先我們要對ChatGPT做一個正名:GPT是 Generative Pretrained Transformer的縮寫,簡單的說他就是一個「預先訓練好的自然語言生成模型」,所以ChatGPT就是訓練好的AI聊天機器人。

就因為它是預先訓練好的,所以作者OpenAI強調目前衹能支持2021年或者以前的知識。雖然他依然能夠利用使用者的回饋來持續訓練,但那衹是微調而已。真正的訓練由於需要非常龐大的運算資源和海量且正確的資料,所以不是隨時隨地可以充電學習的。

除了資料的及時性有限制之外,資料的正確性也無法保證。因為基本上,他的知識還是從網絡上爬來的,所以往往真假難辯,和自己用谷歌搜尋的資料差不了多少,正確性還得自己去判斷。

其次就是對英文之外其他語言的瞭解和表達能力。由於訓練的資料較少,所以正確度不見得很高,再加上各種語言的文法和語義的不同,如果以非英語對稍微複雜一些的問題發問,它的理解以及表達能力可能會打折扣。換句話說,如果要得到最佳效果,應該用簡易的英文去對答。

其實ChatGPT真正令人驚豔的,應該是作文的能耐或者唬爛的功力,它可以將所收到的任何資料,以非常優美的文體振振有詞地,以專家的口吻表達出來。由於它無法獨立辨識資料的正確性,而表達能力又如此天衣無縫,所以一不小心就會得到錯誤的訊息而不自知。

總而言之,到目前為止最有用的,應該是他的對語言的理解和表達能力。如果是編故事,寫詩歌或者寫小說,因為正確性並不重要,而它在大量訓練的過程中,早就將網上最佳作品的寫作方式學習了下來,所以表現往往令人驚豔。在語氣的連貫以及段落之間的起承轉合,也比從前進步了許多。至於編寫程式,比較複雜的可能真得好好測試。

最後,也許有人會好奇地問:它是怎樣學習的,而且表達能力如此豐富?他真的和人類一樣有思考能力嗎?

以最簡單的話來回答,就是它的所謂學習,就是找到問題和答案之間高維度的相關性。在訓練過程中,它已將類似的問題和可能的答案找出了相對應的關係,所以當你問問題的時候,他先將你的問題「編碼」,成為一個有潛在意義的向量(latent vector),然後再加以「解碼」產生相對答案。為了答案的豐富性,在解碼過程當中,答案其實是從一個常態分佈中隨機產生的,所以每次的都會不一樣。

以上個人理解,懇請各位指教。

|

|

| ( 創作|散文 ) |